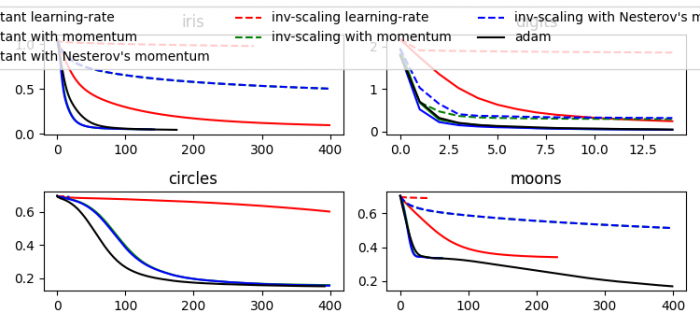

如何适当绘制来自MLPClassifier的(loss_curve_)的损失值?(Matplotlib)

为了适当绘制来自MLPCIassifier的(loss_curve_)的损失值,可以执行以下步骤 –

- 设置图形大小并调整子图之间和周围的填充。

- 制作params,字典列表。

- 制作标签和绘图参数的列表。

- 创建一个带有nrows = 2和ncols =的图形和一组子图。

- 加载并返回鸢尾花数据集(分类)。

- 从数据集中获取x_digits和y_digits。

- 获取自定义数据集,元组列表。

- 通过zip,axes,data_sets和标题名称列表进行迭代。

- 在 plot_on_dataset() 方法中;设置当前轴的标题。

- 获取Multi-layer Perceptron分类器实例。

- 获取 mlps ,即mlpc实例的列表。

- 迭代 mlps 并使用 plot() 方法绘制 mlp.loss_curve_ 。

- 使用 show() 方法显示图形。

例子

import warnings

import matplotlib.pyplot as plt

from sklearn.neural_network import MLPClassifier

from sklearn.preprocessing import MinMaxScaler

from sklearn import datasets

from sklearn.exceptions import ConvergenceWarning

plt.rcParams["figure.figsize"] = [7.50, 3.50]

plt.rcParams["figure.autolayout"] = True

params = [{'solver': 'sgd', 'learning_rate': 'constant', 'momentum': 0, 'learning_rate_init': 0.2},

{'solver': 'sgd', 'learning_rate': 'constant', 'momentum': .9, 'nesterovs_momentum': False, 'learning_rate_init': 0.2},

{'solver': 'sgd', 'learning_rate': 'constant', 'momentum': .9, 'nesterovs_momentum': True, 'learning_rate_init': 0.2},

{'solver': 'sgd', 'learning_rate': 'invscaling', 'momentum': 0, 'learning_rate_init': 0.2},

{'solver': 'sgd', 'learning_rate': 'invscaling', 'momentum': .9, 'nesterovs_momentum': True, 'learning_rate_init': 0.2},

{'solver': 'sgd', 'learning_rate': 'invscaling', 'momentum': .9, 'nesterovs_momentum': False, 'learning_rate_init': 0.2},

{'solver': 'adam', 'learning_rate_init': 0.01}]

labels = ["constant learning-rate", "constant with momentum", "constant with Nesterov's momentum", "inv-scaling learning-rate", "inv-scaling with momentum", "inv-scaling with Nesterov's momentum", "adam"]

plot_args = [{'c': 'red', 'linestyle': '-'},

{'c': 'green', 'linestyle': '-'},

{'c': 'blue', 'linestyle': '-'},

{'c': 'red', 'linestyle': '--'},

{'c': 'green', 'linestyle': '--'},

{'c': 'blue', 'linestyle': '--'},

{'c': 'black', 'linestyle': '-'}]

def plot_on_dataset(X, y, ax, name):

ax.set_title(name)

X = MinMaxScaler().fit_transform(X)

mlps = []

if name == "digits":

max_iter = 15

else:

max_iter = 400

for label, param in zip(labels, params):

mlp = MLPClassifier(random_state=0, max_iter=max_iter, **param)

with warnings.catch_warnings():

warnings.filterwarnings("ignore", category=ConvergenceWarning, module="sklearn")

mlp.fit(X, y)

mlps.append(mlp)

for mlp, label, args in zip(mlps, labels, plot_args):

ax.plot(mlp.loss_curve_, label=label, **args)

fig, axes = plt.subplots(2, 2)

iris = datasets.load_iris()

X_digits, y_digits = datasets.load_digits(return_X_y=True)

data_sets = [(iris.data, iris.target), (X_digits, y_digits), datasets.make_circles(noise=0.2, factor=0.5, random_state=1), datasets.make_moons(noise=0.3, random_state=0)]

for ax, data, name in zip(axes.ravel(), data_sets,

['iris', 'digits', 'circles', 'moons']):

plot_on_dataset(*data, ax=ax, name=name)

fig.legend(ax.get_lines(), labels, ncol=3, loc="upper center")

plt.show()

输出

说明:该文章内容包含图片,其中一张图片路径为E:\Translate\img-2023-0501\20230525163939.png,另一张图片路径为C:\Users\User\Desktop\matplotlib\images\1013.png。

极客教程

极客教程