机器学习中的最大似然

绪论

最大似然是一种常用于密度估计问题的方法,其中定义了一个似然函数以获得分布数据的概率。学习和理解最大似然的概念是非常必要的,因为它是学习其他高级机器学习和深度学习技术和算法的主要和核心概念之一。

在这篇文章中,我们将讨论似然函数,其背后的核心理念,以及它是如何通过代码实例工作的。这将有助于人们更好地理解这一概念,并在需要时加以应用。

让我们先深入了解似然,以理解最大似然估计。

什么是似然

在机器学习中,似然是对数据观察的一种衡量,它可以告诉我们特定数据点的结果或目标变量值。简单地说,顾名思义,似然是一个函数,告诉我们特定数据点适合现有数据分布的可能性有多大。

比如说。假设在数据集中有两个数据点。第一个数据点的可能性比第二个大。在这种情况下,假设第一个数据点为最终模型提供了准确的信息,因此对模型的信息性和精确性来说是很喜欢的。

经过以上讨论,你的脑海中可能会出现一个温柔的问题:如果似然函数的工作原理与概率函数相同,那么有什么区别?

概率和可能性的区别

虽然概率和可能性的工作原理和直觉看起来都是一样的,但还是有一点区别的,这里的可能性是一个函数,它定义或告诉我们特定数据点的准确度有多大的价值,对数据分布中的最终算法的贡献,以及对机器学习算法的可能性有多大。

而概率,用简单的话说就是一个描述某些事件或事物发生的机会的术语,涉及到其他情况或条件,大多被称为条件概率。

另外,与某一特定问题相关的所有概率之和为一,不能超过该概率,而可能性可以大于一。

什么是最大似然估计法

在讨论了似然函数的直觉后,我们很清楚,每个模型都希望有一个较高的似然,以获得一个准确的模型,并有准确的结果。所以在这里,最大似然这个词代表我们在最大化似然函数,称为 似然函数的最大化。

让我们试着用一个例子来理解这一点。

让我们假设我们有一个分类数据集,其中独立列是学生在特定考试中取得的分数,而目标或因果列是分类的,它有是和否的属性,代表学生是否被安排到校园实习中。

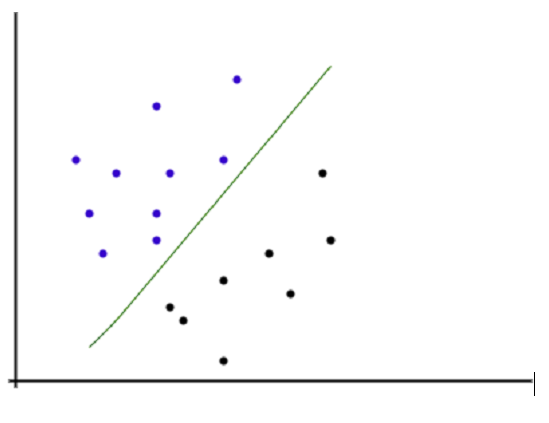

在这里,如果我们试图用最大似然估计来解决同样的问题,该函数将首先根据目标变量的每个合适条件计算每个数据点的概率。在下一步,该函数将在二维图中绘制所有数据点,并试图找到最适合数据集的线,将其分为两部分。在这里,最佳拟合线将在一些历时后实现,一旦实现,该线将被用来对数据点进行分类,只需将其绘制到图上。

最大似然法。基础

最大似然估计是一些用于分类问题的机器学习和深度学习方法的基础。其中一个例子是逻辑回归,该算法用于使用图形上的最佳拟合线对数据点进行分类。同样的方法被称为关于深度学习算法的感知器技巧。

如上图所示,所有的数据观测都被绘制在一个二维图中,其中X轴代表独立列或训练数据,Y轴代表目标变量。画线的目的是为了将正数和负数这两个数据观测值分开。根据该算法,落在线以上的观察值被认为是正数,而线以下的数据点被认为是负数点。

最大似然估计。代码示例

我们可以使用逻辑回归在任何分类数据集上快速实现最大似然估计技术。让我们尝试实现同样的方法。

import pandas as pd

import numpy as np

import seaborn as sns

from sklearn.linear_model import LogisticRegression

lr=LogisticRegression()

lr.fit(X_train,y_train)

lr_pred=lr.predict(X_test)

sns.regplot(x="X",y='lr_pred',data=df_pred ,logistic=True, ci=None)

上述代码将对给定的数据集进行逻辑回归拟合,并根据算法生成代表数据分布和最佳拟合的数据线图。

主要启示

- 最大似然是一个描述数据点和它们与最佳拟合模型的相似性的函数。

-

最大似然法与概率法不同,概率法的工作原理是计算概率。相比之下,似然法试图根据数据分布最大化数据观测的似然性。

-

最大似然法是一种用于解决密度分布等问题的方法,也是一些算法如逻辑回归的基础。

-

这种方法非常相似,在深度学习方法方面,主要被称为感知器的技巧。

总结

在这篇文章中,我们讨论了似然函数,最大似然估计,它的核心直觉,以及与一些关键启示有关的实际例子的工作机制。这将有助于人们更好、更深入地理解最大似然,并有助于非常有效地回答与此相关的面试问题。

极客教程

极客教程