R语言 回归的随机森林方法

随机森林法是一种有监督的学习算法。它建立了多个被称为森林的决策树,并将它们粘合在一起,以促进更准确和稳定的预测。随机森林方法类似于称为Bagging的集合技术。在这种方法中,多棵树是通过训练数据的引导样本产生的,然后我们简单地减少树之间的相关性。执行这种方法可以提高决策树的性能,并有助于避免凌迟。在这篇文章中,让我们学习一下在R编程中使用随机森林方法进行回归。

随机森林的特点

- 聚合许多决策树: 随机森林是一个决策树的集合,因此,不依赖于单一的特征,而是结合每个决策树的多个预测。

- 防止过度拟合: 有了多棵决策树,每棵树都会抽取一个随机数据样本,使随机森林具有更多的随机性,产生比决策树好得多的准确性。

随机森林的优势

- 高效: 在对大型数据库进行处理时,随机森林的效率比决策树高得多。

- 高度准确: 随机森林是高度准确的,因为它们是决策树的集合,每棵决策树都抽取随机数据样本,因此,随机森林在预测方面产生了更高的准确性。

- 对测试误差的有效估计: 它有效地利用了所有预测特征,即使数据缺失也能保持准确性。

随机森林的劣势

- 需要不同数量的层次: 作为决策树的集合,随机森林需要不同数量的层次,以便对训练模型进行非常准确和有偏见的预测。

- 需要大量的内存: 训练一大组树可能需要更多的内存或并行内存。

R语言 实现回归的随机森林方法

R编程中的 randomForest 包被用来创建随机森林。它建立的森林是决策树的集合。函数 randomForest() 用于创建和分析随机森林。

语法:

randomForest(formula, data)

参数:

formula: 代表描述拟合模型的公式

data: 代表包含模型中变量的数据框

要了解更多的可选参数,请使用 help(“randomForest”) 命令。

例子。

第1步:安装所需的软件包。

# Install the required package for function

install.packages("randomForest")

第2步:加载所需的软件包。

# Load the library

library(randomForest)

第3步:在这个例子中,让我们使用R中存在的空气质量数据集。

# Print the dataset

print(head(airquality))

输出 :

Ozone Solar.R Wind Temp Month Day

1 41 190 7.4 67 5 1

2 36 118 8.0 72 5 2

3 12 149 12.6 74 5 3

4 18 313 11.5 62 5 4

5 NA NA 14.3 56 5 5

6 28 NA 14.9 66 5 6

第4步:创建随机森林进行回归

# Create random forest for regression

ozone.rf <- randomForest(Ozone ~ ., data = airquality, mtry = 3,

importance = TRUE, na.action = na.omit)

第5步:打印回归模型

# Print regression model

print(ozone.rf)

输出 :

Call:

randomForest(formula = Ozone ~ ., data = airquality, mtry = 3, importance = TRUE, na.action = na.omit)

Type of random forest: regression

Number of trees: 500

No. of variables tried at each split: 3

Mean of squared residuals: 296.4822

% Var explained: 72.98

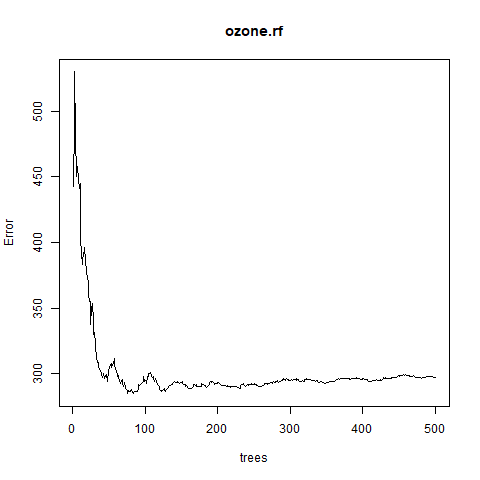

第6步:绘制误差与树木数量的关系图

# Output to be present as PNG file

png(file = "randomForestRegression.png")

# Plot the error vs the number of trees graph

plot(ozone.rf)

# Saving the file

dev.off()

输出:

极客教程

极客教程